Umělá inteligence dnes proniká do stále většího množství digitálních služeb. Firmy ji využívají při analýze dat, v marketingu, zákaznické podpoře nebo při automatizaci procesů. Zároveň ale přibývá situací, kdy algoritmy ovlivňují rozhodování o lidech – například při náboru zaměstnanců, posuzování úvěrů nebo hodnocení studentů.

Právě proto vznikl AI Act, první komplexní legislativa na světě, která nastavuje pravidla pro vývoj a používání umělé inteligence.

Evropská unie se tím snaží vytvořit prostředí, kde se technologie mohou rozvíjet, ale zároveň zůstávají bezpečné a respektují základní lidská práva. AI Act, oficiálně Regulation (EU) 2024/1689, zavádí jednotný právní rámec pro všechny členské státy EU. Jeho cílem není inovace brzdit, ale nastavit jasná pravidla pro vývojáře i firmy, které AI používají.

Regulace podle míry rizika

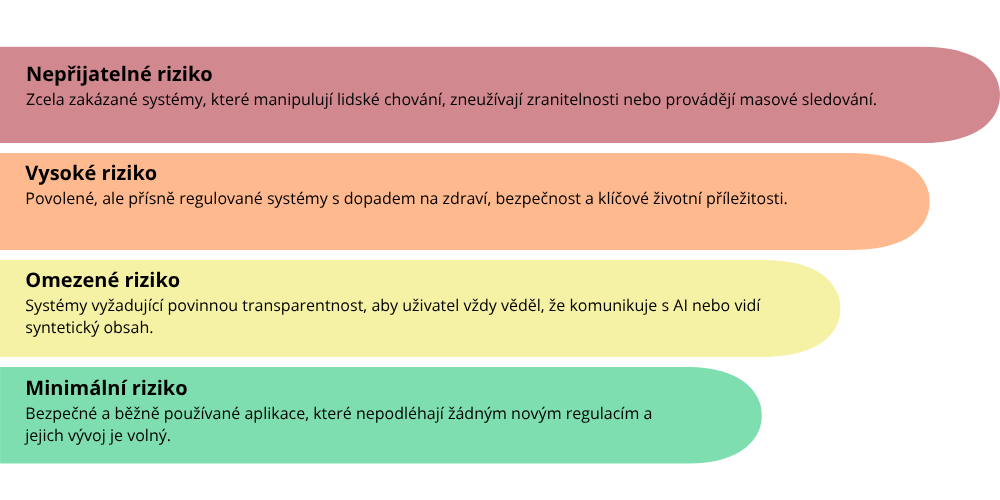

Základním principem AI Actu je tzv. risk-based approach – tedy regulace podle úrovně rizika. Čím větší dopad může mít AI na bezpečnost, práva nebo životy lidí, tím přísnější pravidla musí splňovat. Evropská legislativa proto rozděluje AI systémy do čtyř kategorií – od zcela zakázaných až po systémy, které nepodléhají žádným novým pravidlům.

1. Nepřijatelné riziko

Zákaz těchto AI systémů platí od února 2025. Jde o technologie, které představují přímé ohrožení bezpečnosti, práv nebo důstojnosti lidí, a proto jsou v Evropské unii zcela zakázané. Typicky jde o systémy, které manipulují lidské chování nebo umožňují rozsáhlé sledování a profilování obyvatelstva. Patří sem například:

- manipulativní AI ovlivňující lidské rozhodování

- využívání zranitelnosti skupin (např. děti nebo senioři)

- social scoring hodnotící občany podle chování

- masové databáze pro rozpoznávání obličejů

Tyto praktiky jsou podle EU neslučitelné s ochranou základních práv a důvěrou v digitální technologie.

3. Omezené riziko

Pravidla pro transparentnost začnou platit v srpnu 2026. Tato kategorie se týká AI systémů, které nepředstavují zásadní riziko, ale jejich používání musí být pro uživatele jasně rozpoznatelné. Cílem je zajistit, aby lidé věděli, kdy komunikují s umělou inteligencí nebo kdy je obsah vytvořený algoritmem. Typické příklady:

- chatboti nebo virtuální asistenti

- generativní AI vytvářející text nebo obrázky

- deepfakes nebo syntetická média

- AI nástroje generující obsah pro veřejnost

U těchto systémů musí být uživatelé informováni, že komunikují s AI nebo že obsah byl vytvořen umělou inteligencí.

2. Vysoké riziko

AI Regulace pro high-risk AI začne platit v srpnu 2026 a 2027. Tato kategorie zahrnuje systémy, které mohou výrazně ovlivnit zdraví, bezpečnost nebo základní práva lidí. Technologie v této kategorii nejsou zakázané, ale musí projít přísným procesem posouzení ještě před uvedením na trh. Typické příklady zahrnují:

- AI nástroje používané při náboru zaměstnanců

- systémy rozhodující o úvěrech nebo veřejných službách

- technologie ve vzdělávání a hodnocení studentů

- AI v dopravní infrastruktuře nebo zdravotnictví

Vývojáři musí zajistit kvalitní data, transparentní dokumentaci a možnost lidského dohledu nad systémem.

4. Minimální či žádné riziko

Pro tuto kategorii AI Act nezavádí žádné nové regulatorní povinnosti. Jde o technologie, které jsou považovány za bezpečné a nepředstavují významné riziko pro jednotlivce ani společnost. Většina AI aplikací dnes spadá právě do této skupiny, a proto jejich vývoj může pokračovat bez výrazných omezení. Typickými příklady jsou:

- spam filtry v e-mailových službách

- doporučovací algoritmy online platforem

- AI systémy ve videohrách

- běžné automatizační nástroje

Na koho a na co AI Act dopadá

AI Act se netýká jen velkých technologických firem, které vyvíjejí vlastní modely. Dopadá i na organizace, které umělou inteligenci používají ve svém běžném provozu. To je důležité, protože mnoho firem má pocit, že pokud AI pouze nakupují jako nástroj třetí strany, regulace se jich netýká. Ve skutečnosti ale mohou spadat mezi tzv. deployery – tedy subjekty, které AI využívají v profesní nebo komerční praxi.

Nařízení rozlišuje několik rolí v AI ekosystému a podle nich se také liší povinnosti jednotlivých organizací. Regulace se vztahuje zejména na tyto subjekty:- Poskytovatelé (providers) – organizace, které AI systémy vyvíjejí nebo uvádějí na trh pod svým jménem

- Deployeři (zavádějící subjekty) – firmy nebo instituce, které AI používají při své činnosti

- Dovozci – společnosti, které uvádějí na evropský trh AI systémy vyvinuté mimo EU

- Distributoři – subjekty, které AI systémy dále zpřístupňují na trhu EU

Důležité je také to, že pravidla nejsou omezená pouze na firmy sídlící v EU.

AI Act může dopadat i na společnosti mimo Evropskou unii, pokud jsou výstupy jejich AI systémů používány na evropském trhu.

Regulace se navíc týká nejen soukromého sektoru, ale i veřejné správy – například úřadů, škol, nemocnic nebo bezpečnostních složek, pokud AI využívají v procesech, které mohou ovlivnit práva, bezpečnost nebo přístup ke službám.

Co to znamená v praxi pro firmy

Pro většinu organizací bude AI Act znamenat především potřebu lépe zmapovat a řídit používání umělé inteligence. Mnoho firem dnes AI využívá v různých nástrojích nebo procesech, aniž by měly jasný přehled o tom, kde všude se technologie používá a jaké dopady může mít. Prvním krokem by proto měla být inventura AI systémů – tedy přehled všech nástrojů a aplikací, které firma používá, vyvíjí nebo integruje do svých procesů. Následně je potřeba posoudit, do jaké rizikové kategorie jednotlivé systémy spadají a zda na ně dopadají specifické povinnosti podle AI Actu. V praxi by se firmy měly zaměřit zejména na tyto kroky:

- zmapovat všechny AI nástroje používané ve firmě vyhodnotit jejich rizikovost podle kategorií AI Actu

- nastavit základní AI governance a odpovědnosti

- prověřit dodavatele AI řešení a smluvní podmínky

- zvýšit povědomí zaměstnanců o pravidlech používání AI

Zvláštní pozornost je vhodné věnovat oblastem, kde AI může přímo ovlivňovat rozhodování o lidech nebo jejich právech – například v HR, při hodnocení osob, biometrické identifikaci nebo při automatizovaném rozhodování o přístupu ke službám. Díky systematickému přístupu mohou firmy minimalizovat regulatorní rizika a zároveň využívat AI technologie bezpečně a v souladu s novými pravidly.

Začněte jednoduchým AI auditem

Nemusíte hned řešit celý compliance framework. Úplně první a nejpraktičtější krok je sepsat, jaké AI nástroje ve firmě používáte, k čemu slouží, kdo je dodává a jestli nějak nezasahují do rozhodování o lidech, biometriky nebo citlivých procesů. Právě tohle bývá moment, kdy firmy zjistí, že AI používají mnohem víc, než si původně myslely.

Co čekat dál

AI Act sice už platí, ale jeho jednotlivé části nabíhají postupně. To znamená, že v následujících měsících a letech budou přibývat další metodiky, pokyny Evropské komise, kodexy správné praxe i harmonizované normy, které pomohou pravidla převést do konkrétnější praxe. Pro firmy to znamená dvě věci. Za prvé, vyplatí se sledovat další vývoj a nepracovat jen s tím, co bylo známo při schválení nařízení. A za druhé, je rozumné začít s přípravou už teď, protože až budou pravidla plně účinná, nebude prostor na řešení všechno od nuly.

Shrnutí

AI Act je první skutečně komplexní regulace umělé inteligence a je dost pravděpodobné, že podobně jako GDPR ovlivní i širší globální debatu o tom, jak AI používat bezpečně a odpovědně. Pro firmy to není jen další evropská administrativa navíc, ale signál, že práce s AI bude potřeba řídit mnohem systematičtěji než dosud. Čím dřív si organizace udělají jasno v tom, kde AI používají, jaká rizika z toho plynou a kdo za tyto nástroje odpovídá, tím menší bude šance, že je nové povinnosti zaskočí. A upřímně, tohle je přesně jedna z těch oblastí, kde se opravdu nevyplácí začít řešit věci na poslední chvíli.

Vytvoříme pro vás digitální řešení,

která hrají podle pravidel.

Propojujeme špičkové technologie s bezpečnou praxí, od e-shopů po sociální sítě.